El desarrollo de las tecnologías de la ‘Cuarta Revolución Industrial’, como toda revolución tecnológica, ofrece aportes positivos para la humanidad, pero también riesgos. Estos pueden referirse, como muchos temen, a eliminar los empleos tradicionales sin que se consoliden nuevas fuentes de empleo; al desarrollo de robots con IA (inteligencia artificial) que puedan actuar sin supervisión humana y sin el establecimiento de reglas de ética que limiten comportamientos violentos; o, como en el caso que nos ocupa, al desarrollo de armas autónomas que puedan ser utilizadas por líderes desquiciados, terroristas o antisociales.

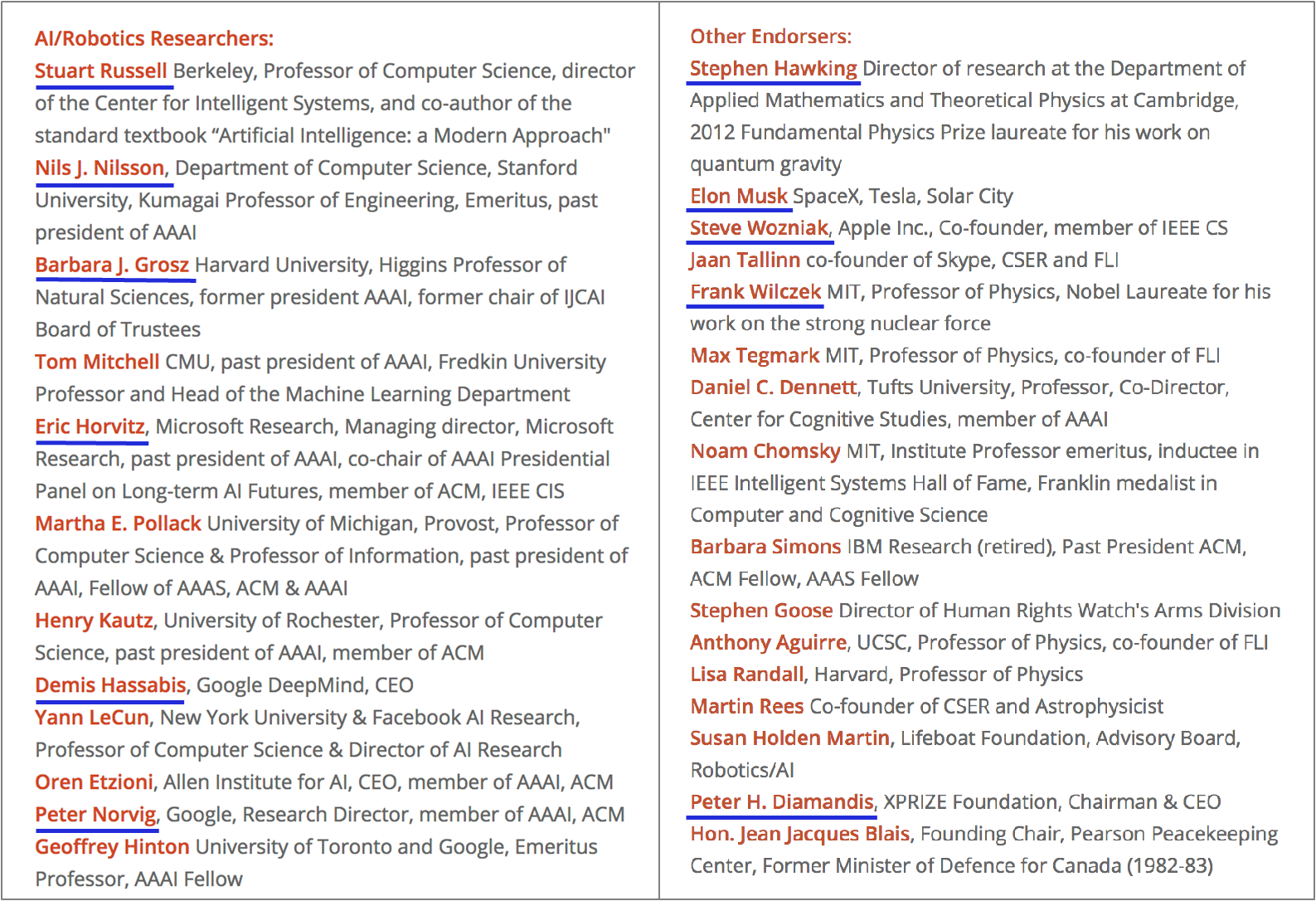

Líneas abajo compartimos las cartas promovidas por ElonMusk, creador y CEO Tesla, desde el ‘Future of LifeInstitute’ (Instituto de la Vida Futura), acompañadas por las firmas de 3,105 expertos en el desarrollo de Inteligencia Artificial y Robótica y 17,701 líderes globales en distintas disciplinas, como el físico Stephen Hawking, Steve Wozniak, cofundador de Apple, ….., Peter Diamandis, de XPRIZE y SingularityUniversity, entre otras notabilidades.

“Las armas autónomas son ideales para tareas como asesinatos, desestabilización de naciones, sometimiento de poblaciones y eliminación selectiva de determinados grupos étnicos”. Dice ElonMusken una de las misivas.“Las armas letales autónomas amenazan con convertirse en la tercera revolución en la guerra. Una vez desarrolladas, permitirán que el conflicto armado se libere a una escala mayor que nunca, y a intervalos de tiempo más rápidos de lo que los humanos pueden comprender”, recalcó recientemente.

Una de las cartas promueve las adhesiones de todas las personas conscientes de los riesgos señalados. Para firmarlo, se puede llenar el formulario aquí abajo:

Invitamos a nuestros lectores a unirse a esta iniciativa en pro de la vida y el buen uso de las tecnologías. Lampadia

Carta abierta a la Convención de las Naciones Unidas sobre ciertas armas convencionales

Elon Musk

Future of Life Institute

20 de agosto de 2017

Traducido y glosado por Lampadia

Como empresas que desarrollamos las tecnologías de Inteligencia Artificial (IA) y Robótica, que pueden ser reutilizadas para desarrollar armas autónomas, nos sentimos especialmente responsables al levantar esta alarma.

Acogemos la decisión de la Conferencia de las Naciones Unidas sobre la Convención sobre Ciertas Armas Convencionales (CCW, por sus siglas en inglés) de establecer un Grupo de Expertos Gubernamentales (GGE, por sus siglas en inglés) sobre Sistemas de Armas Letales Autónomas. Muchos de nuestros investigadores e ingenieros están ansiosos por ofrecer asesoramiento técnico a sus deliberaciones.

Felicitamos al nombramiento del Embajador Amandeep Singh Gill, de la India, como Presidente del GGE. Instamos a las Altas Partes Contratantes que participan en el GGE a que trabajen arduamente en la búsqueda de medios para impedir una carrera de armamentos en estas armas, proteger a los civiles de su uso indebido y evitar los efectos desestabilizadores de estas tecnologías.

Lamentamos que la primera reunión del GGE, que debía comenzar hoy, haya sido cancelada debido a que un pequeño número de Estados no han pagado sus contribuciones financieras a la ONU. Instamos a las Altas Partes Contratantes a que, por lo tanto, dupliquen sus esfuerzos en la primera reunión del GGE prevista para noviembre.

Las armas letales autónomas amenazan con convertirse en la tercera revolución en la guerra. Una vez desarrolladas, permitirán que el conflicto armado se libere a una escala mayor que nunca, y a intervalos de tiempo más rápidos de lo que los humanos pueden comprender. Pueden ser armas de terror, armas que los déspotas y los terroristas usen contra poblaciones inocentes, y armas para comportarse de manera indeseable. No tenemos mucho tiempo para actuar. Una vez que se abra esta caja de Pandora, será difícil de cerrar. Por lo tanto, imploramos a las Altas Partes Contratantes que encuentren una manera de protegernos a todos de estos peligros.

Armas Autónomas: Una carta abierta de los investigadores IA & Robótica

Elon Musk

Future of Life Institute

Julio de 2015

Traducido y glosado por Lampadia

Esta carta abierta fue anunciada el 28 de julio en la apertura de la conferencia IJCAI 2015 el 28 de julio.

Las armas autónomas seleccionan y ajustan objetivos sin intervención humana. Pueden incluir, por ejemplo, cuadriciclos armados que pueden buscar y eliminar personas que cumplan ciertos criterios predefinidos, pero no incluyen misiles de crucero o aviones teledirigidos, los cuales son dirigidos por los seres humanos, quienes toman todas las decisiones. La tecnología de Inteligencia Artificial (IA) ha alcanzado un punto en el que el despliegue de estos sistemas es prácticamente (si no legalmente) factible en años, no décadas, y los riesgos son altos: las armas autónomas han sido descritas como la tercera revolución en la guerra, después de la pólvora y las armas nucleares.

Muchos argumentos se han hecho a favor y en contra de las armas autónomas, por ejemplo, que la sustitución de los soldados humanos por las máquinas es buena, reduciendo las bajas de personas, pero malo porque reduce el umbral para ir a la batalla. Hoy en día, la pregunta clave para la humanidad es si debemos iniciar una carrera armamentista global de la IA o impedir que comience. Si cualquier potencia militar importante avanza en el desarrollo de las armas de AI, una carrera de armamentos mundial es prácticamente inevitable y el punto final de esta trayectoria tecnológica es obvia: las armas autónomas se convertirán en los Kalashnikov de mañana. A diferencia de las armas nucleares, no requieren materias primas costosas o difíciles de obtener, por lo que se convertirán en ubicuas y baratas para que todas las potencias militares significativas las produzcan en masa. Sólo será cuestión de tiempo hasta que aparezcan en el mercado negro y en manos de terroristas, dictadores que deseen controlar mejor a su población, hombres de la guerra que deseen perpetrar limpiezas étnicas, etc. Las armas autónomas son ideales para tareas como asesinatos, desestabilización de naciones, sometimientode poblaciones y eliminación selectiva de determinados grupos étnicos. Por lo tanto, creemos que una carrera armamentista militar de IA no sería beneficiosa para la humanidad. Hay muchas maneras en que la IA puede hacer que los campos de batalla sean más seguros para los humanos, especialmente para los civiles, sin crear nuevas herramientas para matar a la gente.

Al igual que la mayoría de los químicos y biólogos no tienen ningún interés en la construcción de armas químicas o biológicas, la mayoría de los investigadores de IA no tienen interés en la construcción de armas de IA – y no quieren que otros empañen su campo al hacerlo, potencialmente creando una gran reacción pública en contra de la IA que podría restringirsus futuros beneficios sociales. De hecho, los químicos y los biólogos han apoyado ampliamente los acuerdos internacionales que han prohibido con éxito las armas químicas y biológicas, al igual que la mayoría de los físicos apoyaron los tratados que prohíben las armas nucleares espaciales y las cegadoras armas láser.

En resumen, creemos que IA tiene un gran potencial para beneficiar a la humanidad de muchas maneras y que la meta de quienes están involucrados en el sector debe ser lograrlo. Comenzar una carrera armamentista militar de IA es una mala idea y debe ser prevenida por una prohibición de armas autónomas ofensivas más allá de un control humano significativo. Lampadia